Нужно и можно ли писать большие тексты под коммерческие запросы?

Можно и нужно. Долгое время считалось почему-то, что под так называемые «коммерческие запросы» не нужно писать большие, содержательные тексты, и не только не нужно, но и даже вредно.

Это в принципе было верно, но уже давно перестало быть таковым. До появления Матрикснета и аналогичных технологий Google, и уж тем более до внедрения нейронных сетей в поисковые системы, это было актуально: было общее понимание, что интенты (запросы) посетителей сайта различны, иногда им интересна информация, чтобы разобраться, а иногда они ищут конкретный товар и/или услугу, чтобы прямо сейчас их купить. И понятно, что веб-страница должна по-разному «обыгрывать» эти интенты. В первом случае на странице будет много информации и деталей и нюансов выбора этого товара. А во втором случае информации вроде бы должно быть минимум, а много удобства использования. И кажется, что это логично. Но если посмотреть в детали, то окажется, что все не так очевидно.

Во-первых, каждый отдельно взятый запрос редко будет лишь одного типа – коммерческого или информационного. Интенты, скорее всего, будут смешиваться. Это происходит из-за того, что общество представляет собой сложноорганизованную систему разнокачественных страт. И у разных страт различные интересы. И эти разные интересы формируют разные интенты.

Поэтому одна и та же страница должна «обыгрывать» различные интенты, то есть удовлетворять интересам различных групп пользователей. Уже одно это говорит нам, что большие тексты возможны на страницах, ориентированных на коммерческие запросы. И это позволяет нам понять, почему анализ нейросетями приводит именно к такому результату, к которому приводит – показывает, что лонгриды на коммерческих запросах иногда работают очень хорошо.

Но несмотря на это долгое время считалось – вопреки всякой логике, – что большие тексты вредны для коммерческих страниц. Последовательное применение принципов SEO и истолкование результатов такого применения уже несколько лет как позволяло делать вывод, что лонгриды на коммерческих страницах работают. Но логика многим не указ.

Коротко: даже из общих соображений ясно (при должном использовании гипотетико-дедуктивного подхода), что лонгриды для коммерческих запросов могут быть эффективны, в том числе и для главных страниц сайта. С началом использования машинного обучения это стало ясно и поисковым роботам.

Можно зайти и с другой стороны. Насыщенный информацией текст на странице коммерческого запроса – это реализация последовательно применяемой энциклопедической seo-стратегии. Еще несколько лет назад она, несмотря на то, что была весьма эффективно применяема на практике, была уделом лишь немногих; большинство, которое идет на шаблонами, правильными с точки зрения некоторых авторитетов, а не за логикой, не применяла её, а зря. Теперь потихоньку реализация этой перспективной стратегии выходит в публичное пространство. И, надеюсь, сейчас после такого выхода в свет (но уже лет на пять позже аванграда) стратегию начнут успешного применять более массово. Проанализируем нижеследующее видео, записанное значимыми игроками публичного SEO-пространства.

«Как оказалось, такое можно применять не только для информационных запросов, но и для очень даже коммерческих, и причем использовать это для главных страниц сайта».

«Сайт, который обогнал с минимальным количеством ссылок, а у меня, поверьте, в этой тематике очень много ссылок стоит на мой сайт. То есть я стоял в ТОП-1, а этот сайт стал с таким текстом за довольно-таки небольшой период сразу в топ».

«Суть такой главной страницы, чтобы раскрыть всю нишу. То есть она будет брать запросы, которые связаны с разделоми, с подразделами, с подподразделами. Если у вас уже есть созданные странички вы просто будете на них линковать».

Итак из приведённых цитат мы видим, что если страница раскрывает содержание ниши достаточно полно, то она имеет все шансы за относительно короткое время попасть в ТОП по коммерческому запросу. Это верно и для главных страниц. Самое важное – это полнота и глубина раскрытия тематик данной ниши.

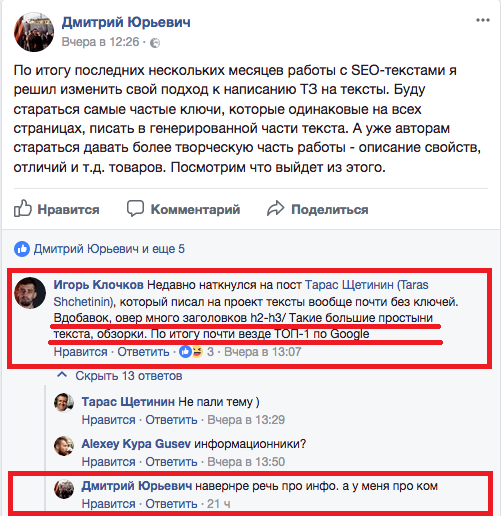

Однако, несмотря на очевидную логичность, тезис о том, что использовать большие тексты можно и нужно для высочастотных запросов в высококонкурентных тематиках, пока еще иногда встречает существенные возражения в профессиональном сообществе. Так, например, проанализируем пост.

Видим, что автор поста в переписке высказывает сомнение, что «простыни текста» подходят для коммерческих запросов. Однако, его собеседник прямо утверждает, что это «коммерция» и «высококонкурентные ниши». Далее разъясняет, что ключ ко всему – экспертные, глубокие тексты и что, по-видимому, они возможны даже в незатейливых тематиках – типа покупки чехла на айфон или чёрного чая.

Коротко: использовать очень большие, экспертные тексты для высокочастотных запросов в высококонкурентных тематиках можно и нужно.